Основы теории вероятностей случайных сигналов

Тема 8: основы теории вероятностей случайных сигналов

Таковы первичные законы, установленные природой.

Вергилий. Георгики. (Римский поэт)

"Природа не злонамеренна, но коварна". Это не закон. Это только следствие теории вероятностей. И все же непонятно, почему единственная муха в ресторане падает именно в мой суп.

Владимир Бакаев. Наблюдения. (Уральский геофизик)

Содержание: 8.1. Основные понятия теории вероятностей. События и явления. Классификация случайных событий. Сумма событий. Произведение событий. Полная группа событий. Сложные события. 8.2. Вероятности случайных событий. Частотное определение. Определение на основе меры. Основные положения теории вероятностей. Сложение вероятностей. Условная вероятность. Умножение вероятностей. Независимость событий. Формула полной вероятности. Формула Байеса. 8.3. Случайные величины. Общие понятия. Вероятности случайных величин. Функции от случайной величины. Моменты распределения. Основные числовые характеристики случайных величин. Некоторые распределения случайных величин. Характеристическая функция. 8.4. Системы случайных величин. Функция распределения вероятностей системы. Плотность вероятностей системы. Условные законы распределения. Функции регрессии. Статистическая независимость случайных величин. Моменты систем случайных величин. Сумма и разность случайных величин. Литература.

8.1. Основные понятия теории вероятностей [л28,л29].

Теория вероятностей - один из разделов математики, в котором изучаются закономерности случайных массовых событий, явлений и процессов независимо от их физической природы.

События и явления. Все события и явления реального мира разделяются на закономерные (детерминированные) и случайные (вероятностные).

Рекомендуемые материалы

Закономерные события происходят при создании определенных условий, подчиняются определенным физическим законам и на основании этих законов однозначно предсказываются и изменяются. Возникновение тока в электрической цепи при подключении ее к источнику напряжения - закономерное событие, а сила тока в цепи может определяться и изменяться на основании закона Ома. Закономерное явление - это система, совокупность или последовательность закономерных событий. Генерация импульсного потока - закономерное явление, т.к. и форма импульсов, и время их появления задаются определенными физическими процессами в электрической схеме генератора.

Случайным событием называется такое событие, изменить или предсказать которое в процессе случайного явления невозможно. Случайное событие - это результат (исход) конкретной единичной реализации случайного явления. Так, выпадение чисел 1-6 при бросании игральной кости - случайное явление. Выпадение числа 6 в единичном испытании - случайное событие. Если оно может задаваться, то это уже не игральная кость, а инструмент шулера. Типовое обозначение случайных событий - крупными буквами алфавита (например, событие А - выпадение 1 при бросании кости, событие В - выпадение 2 и т.д.).

Случайность событий может быть обусловлена как собственной физической природой явлений, что характерно для большинства физических процессов в микромире (например, распад радиоактивных ядер), так и определенным вероятностным характером реализации явлений в силу их многофакторной и, как правило, нелинейной зависимости от внешних и внутренних условий, что характерно для процессов в макромире. Например, индивидуализация исхода бросания игральной кости начинается с вариации некоторых начальных условий (положение в пространстве, скорость и направление движения, момент инерции, момент вращения и пр.) и продолжается на всем пути движения кости вплоть до остановки (трение о воздух, положение в момент удара о стол, поглощение энергии удара и пр.). Невозможность точного повторения всех условий опыта определяет случайность результата.

Нетрудно заметить, что понятие случайности явлений, а равно и границы между случайными и закономерными явлениями, довольно расплывчато и существенно зависит не только от природы самих явлений, но и от возможностей задания постоянных условий реализации явлений и фиксирования результатов. Падение напряжения на резисторе при задании через него тока - явление закономерное и значение напряжения может быть "предсказано" со сколь угодно высокой точностью при соответствующей точности задания сопротивления резистора и значения тока. Однако, как известно, если провести серию измерений этого напряжения прибором более высокой точности, то результаты измерений следует отнести к величинам случайным. Измеренные значения не будут выходить за пределы заданной точности, но и не будут повторяться в силу влияния самых различных дестабилизирующих факторов (температура, влажность, электромагнитные помехи и т.п.) как на сам измерительный прибор, так и на объект измерений. Более того, даже если мысленно идеализировать условия опыта и повысить точность задания параметров объекта, то и в этом случае мы выйдем на определенную случайность результатов измерений уже в силу дискретной природы самого электрического тока и флюктуаций движения электронов в резисторе.

С практической точки зрения явление или процесс считаются случайными, если в их формировании в той или иной форме присутствует неопределенность и невозможно с заданной точностью предсказать результаты их конкретных реализаций, физического отображения и измерения в ходе контролируемых экспериментов или повторить в ходе многократных реализаций.

Классификация случайных событий. Событие называют достоверным (и обозначают индексом W), если оно однозначно и предсказуемо. Выпадение суммы чисел больше 1 и меньше 13 при бросании двух костей - достоверное событие. Событие является невозможным (и обозначается индексом Æ), если в данном явлении оно полностью исключено. Сумма чисел, равная 1 или большая 12 при бросании двух костей - события невозможные. События равновозможны, если шансы на их появление равны. Появление чисел 1-6 для игральной кости равновозможно.

Два события называются совместными, если появление одного из них не влияет и не исключает появление другого. Совместные события могут реализоваться одновременно, как, например, появление какого-либо числа на одной кости ни коим образом не влияет на появление чисел на другой кости. События несовместны, если в одном явлении или при одном испытании они не могут реализоваться одновременно и появление одного из них исключает появление другого (попадание в цель и промах несовместны).

Сумма событий представляет собой такое объединение событий в одно новое событие, сущность которого заключается в реализации хотя бы одного из объединяемых событий: S = A+B+...+N. Такая операция представляет собой аналог дизъюнкции - логического сложения (логическое "ИЛИ"), и может записываться в виде S = AÈBÈ...ÈN. Так, если события А,В,С - поражение цели соответственно при 1-ом, 2-ом и 3-ем выстреле, то событие S=A+B+C - поражение цели вообще, т.е. любым выстрелом, в том числе двукратное и трехкратное.

Произведение событий представляет собой совмещение событий в одном новом событии, в совместном появлении всех совмещаемых событий: S = A×B× ... ×N. Такая операция представляет собой аналог логической конъюнкции (логическое "И"), и может записываться в виде S = AÇBÇ...ÇN. Продолжая предыдущий пример, событие Z - трехкратное попадание в цель, определяется выражением: Z = A×B×C.

Попутно заметим, что для логических операций имеем: А+А=А и А×А=А.

Полная группа событий. События какого-либо случайного явления образуют полную группу, если в результате единичной реализации явления обязательно произойдет хотя бы одно из них, т.е. выполняется условие: А+В+ ... +N = W (сумма событий полной группы º достоверное событие). Выпадение чисел 1-6 при бросании кости - полная группа событий.

Если полную группу образуют только два несовместных события, как выпадение герба или решки при бросании монеты, то такие события называются противоположными. При обозначении одного из таких событий определенным индексом, например - А, второе обычно обозначается тем же индексом с крышкой сверху:  . Соответственно А+

. Соответственно А+ = W. Произведение несовместных событий является событием невозможным. В частности, А×

= W. Произведение несовместных событий является событием невозможным. В частности, А× = Æ.

= Æ.

Сложные события. Различают элементарные (простые) и сложные события. Элементарные события не разделяются на составные события. Выпадение числа при бросании кости - элементарное событие. Сложные события составляются из двух или нескольких элементарных событий. Так, если в примере с тремя выстрелами в цель нас интересует событие D, заключающееся в попадании в цель не менее двух раз, то оно определяется следующим выражением:

D = A×B× +A×

+A× ×C+

×C+ ×B×C+A×B×C

×B×C+A×B×C

8.2. Вероятности случайных событий [л30,л28,л29].

Предсказание конкретной реализации случайных событий невозможно. Однако интуитивная ориентировка в случайных событиях известна каждому. Если при игре в кости дважды выпали две шестерки, то едва ли кто-нибудь в третий раз поставит на 12 очков. Это определяется тем, что и случайные события подчиняются определенным вероятностным закономерностям и при повторениях испытаний предсказуемы "в среднем".

Понятие вероятности событий относится к фундаментальным понятиям теории вероятностей. Вероятность случайного события является количественной мерой степени объективной возможности появления этого события в единичном опыте (в единичной реализации случайного явления). На протяжении последних трех веков достаточно интенсивного развития теории вероятностей многие ученые делали попытки сформулировать это фундаментальное понятие на основе строгой логики. Приведем только два из них.

Частотное определение. При N реализациях некоторого случайного явления случайное событие А наблюдалось n раз. Если случайные события в этом явлении взаимно независимы, несовместны и составляют полную группу, то вероятность события А определяется выражением:

P(A) = (8.2.1)

(8.2.1)

Так как диапазон значений n в данном выражении ограничен интервалом 0 £ n £ N, то отсюда следует, что значения вероятностей событий заключены в интервале от 0 до 1.

Пример. В урне находятся 5 белых и 7 черных шаров. Какова вероятность извлечь из урны 3 белых шара?

Общее число возможных способов извлечь 3 шара из 12 равно числу сочетаний из 12 по 3:

N = 12!/(3!×9!) = 220.

Число возможных сочетаний из 5 белых шаров по 3: n = 5!/(3!×2!) = 10.

Искомая вероятность: P = n/N = 10/220.

При практических оценках вероятностей значение (n/N) называют относительной частотой (или частностью) данного события в данной серии наблюдений. Относительная частота событий при многократных наблюдениях является достаточно устойчивой величиной, флюктуирующей в окрестностях вероятности данных событий, причем величина флюктуаций тем меньше, чем больше количество наблюдений.

Определение на основе меры. Введем пространство (множество) W, элементы которого wi являются случайными элементарными событиями, т.е. W = wi. Определим в этом пространстве неотрицательную меру P(w), которую назовем вероятностью, со следующими свойствами:

wi. Определим в этом пространстве неотрицательную меру P(w), которую назовем вероятностью, со следующими свойствами:

1. P(W) = 1, т.е. вероятность появления события, принадлежащего к данному пространству (wi Î W), равна 1 (условие нормировки меры).

2. Если подмножества элементарных событий А Î W и В Î W, каждое из которых принадлежит данному пространству W, не имеют общих элементов, то Р(А+В) = Р(А) + Р(В), т.е. вероятность того, что наблюдаемое событие принадлежит либо подмножеству А, либо подмножеству В, равна сумме вероятностей наблюдать это событие отдельно в подмножествах А и В.

|

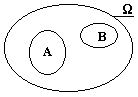

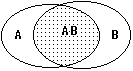

Рис. 8.2.1. |

Для иллюстрации различных положений теории вероятностей удобно использовать условные графические отображения пространств случайных событий, пример которых приведен на рис. 8.2.1. Полное пространство W элементарных событий wi ограничивается произвольным контуром, площадь которого принимается равной 1 и равна вероятности появления событий wi в пространстве W, при этом полагается, что события wi равномерно заполняют пространство W. Группы событий w Î A или w Î В отображаются соответственно замкнутыми контурами внутри пространства W с площадями, равными вероятностям событий А и В.

Основные положения теории вероятностей вытекают непосредственно из определения понятия вероятности.

1. Вероятность любого случайного события А является неотрицательной величиной, значение которой заключено в интервале от 0 до 1.

0 £ Р(А) £ 1.

2. Вероятность достоверного события равна 1.

Р(W) = 1. (8.2.2)

В общем случае событие W представляет собой сумму полной группы возможных элементарных событий данного случайного явления: W = wi. Следовательно, вероятность реализации хотя бы одного случайного события из полной группы возможных событий также равна 1, т.е. является событием достоверным.

wi. Следовательно, вероятность реализации хотя бы одного случайного события из полной группы возможных событий также равна 1, т.е. является событием достоверным.

|

Рис. 8.2.2. |

Сумма противоположных событий тоже составляет полную группу событий и соответственно вероятность суммы противоположных событий равна 1 (рис. 8.2.2):

P(A+ ) = 1. (8.2.3)

) = 1. (8.2.3)

Примером может служить бросание горсти монет. Орел или решка для каждой монеты – противоположные события. Сумма событий для горсти в целом равна 1 независимо от соотношения выпавших орлов и решек.

3. Вероятность невозможного события равна 0.

Р(Æ) = 0. (8.2.4)

|

Рис. 8.2.3. |

Пусть Ф - пустое пространство (не содержащее событий). Тогда W+Ф = W и пространство W не содержит событий, общих с пространством Ф (рис. 8.2.3). Отсюда следует, что Р(W+Ф) = Р(W) + Р(Ф) = Р(W), что выполняется при Р(Ф) = 0. Другими словами, если одно из событий обязательно должно происходить, то вероятность отсутствия событий должна быть равна нулю. Но при этом W является достоверным событием, а Ф = Æ (невозможное событие) и соответственно Р(Æ) = 0.

Сложение вероятностей зависит от совместности и несовместности событий.

Несовместные события. Вероятность суммы двух несовместных событий А и В равна сумме вероятностей этих событий. Это вытекает из того, что множество С = А+В включает подмножества А и В, не имеющие общих точек, и Р(А+В) = Р(А)+Р(В) по определению вероятности на основе меры. По частотному определению вероятности в силу несовместности событий имеем:

P(A+B) =  =

=  +

+ = P(A) + P(B),

= P(A) + P(B),

где n и m - число случаев появления событий А и В соответственно при N испытаниях.

Противоположные события также являются несовместными и образуют полную группу. Отсюда, с учетом (8.2.3):

P( ) = 1 - Р(А). (8.2.5)

) = 1 - Р(А). (8.2.5)

|

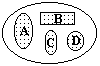

Рис. 8.2.4. |

В общем случае для группы несовместных событий (рис. 8.2.4):

P(A+B+...+N) = P(A) + P(B) + ... + P(N), (8.2.6)

если все подмножества принадлежат одному множеству событий и не имеют общих точек (попарно несовместны). А если эти подмножества образуют полную группу событий, то с учетом (8.2.2):

P(A) + P(B) + ... + P(N) = 1. (8.2.7)

|

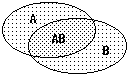

Рис. 8.2.5. |

Совместные события. Вероятность появления хотя бы одного из двух совместных событий равна сумме вероятностей этих событий без вероятности их совместного появления (рис. 8.2.5):

P(A+B) = P(A) + P(B) - P(A×B). (8.2.8)

Разобьем события А и В каждое на два множества, не имеющие общих точек: А', A'' и B', B''. Во множества А'' и B'' выделим события, появляющиеся одновременно, и объединим эти множества в одно множество С. Для этих множеств действительны выражения:

С = A''×B'' º А'' º В'' º А×В, P(C) = P(A'') = P(B'') = P(A×B).

P(A) = P(A')+P(A''), P(A') = P(A)-P(A'') = P(A)-P(A×B).

P(B) = P(B')+P(B''), P(B') = P(B)-P(B'') = P(B)-P(A×B).

Множества A', B' и С не имеют общих точек и можно записать:

P(A+B) = P(A'+B'+C) = P(A') + P(B') + P(С).

Подставляя в правую часть этого уравнения вышеприведенные выражения, приходим к выражению (8.2.8). Физическая сущность выражения достаточно очевидна: суммируются вероятности событий А и В и вычитаются вероятности совпадающих событий, которые при суммировании сосчитаны дважды.

Пример. Вытащим одну карту из колоды (52 карты). Какова вероятность того, что карта окажется или тузом, или пиковой мастью?

Р = Р(туз) + Р(пики) - Р(туз пик) = (4/52) + (13/52) - (1/52) = 16/52.

В общем случае, для m различных событий А1, А2, ..., Аm:

P(A1+...+ Am) = P(Ai) -

P(Ai) - P(Ai×Aj) +

P(Ai×Aj) + P(Ai×Aj×Ak) -...+(-1)m+1P(A1×A2× ... ×Am). (8.2.9)

P(Ai×Aj×Ak) -...+(-1)m+1P(A1×A2× ... ×Am). (8.2.9)

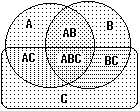

|

Рис. 8.2.6. |

На рис. 8.2.6 на примере трех пространств можно видеть причины появления в выражении (8.2.9) дополнительных сумм вероятностей совпадающих пространств и их знакопеременности. При суммировании вероятностей пространств А,В и С, имеющих общее пространство АВС, его вероятность суммируется трижды, а при вычитании вероятностей перекрывающихся подпространств АВ, АС и ВС трижды вычитается (т.е. обнуляется), и восстанавливается дополнительным суммированием с вероятностью пространства АВС.

Условная вероятность совместных событий. Предположим, что в пространстве событий с полным числом исходов N событие А может осуществляться n1 способами (вероятность P(A) = n1/N), событие В - n2 способами, а события А и В одновременно - n12 способами. При этом:

P(AВ) = n12/N = (n1/N)(n12/n1) = P(A)×(n12/n1). (8.2.10)

Второй сомножитель выражения (8.2.10) из общего числа случаев n1 события А определяет долю, когда одновременно происходит и событие В, т.е. вероятность события В при условии, что произошло событие А. Эта вероятность называется условной вероятностью события В по событию А и записывается в виде Р(В/А):

Р(В/А) = Р(АВ)/Р(А). (8.2.11)

Пример. Вытащим две карты из колоды (52 карты). Событие А - первая карта определенной масти. Событие В - вторая карта той же масти. Какова вероятность появления второй карты той же масти?

Р(А) = 13/52. Карта не возвращается в колоду, следовательно, Р(В/А) = (13-1)/(52-1).

В общем случае может определяться условная вероятность события В в предположении, что произошли события А1, А2 и др.: Р(В/А1,А2,...).

Для условной вероятности событий B по событиям A применяется также обозначение РA(B).

|

Рис. 8.2.7. |

Умножение вероятностей совместных событий. Формула определения вероятности события А×В (А и В одновременно, рис. 8.2.7), которую обычно называют формулой умножения вероятностей, непосредственно следует из выражения (8.2.11):

Р(АВ) = Р(А)×Р(В/А) º Р(В)×Р(А/В). (8.2.12)

Пример. Вытащим две карты из колоды (52 карты). Событие А - первая карта определенной масти. Событие В - вторая карта той же масти. Какова вероятность появления двух карт одной масти?

Р(А) = 13/52. Р(В/А) = (13-1)/(52-1). Р(АВ) = (13×12)/(52×51) @ 0.0588

В общем случае, вероятность умножения нескольких событий равна произведению вероятности одного из этих событий на условные вероятности других:

P(A1×A2×...×An) = P(A1)×P(A2/A1)×P(A3/A2A1)× ... ×P(An/ Ai). (8.2.12')

Ai). (8.2.12')

Независимость событий. Если появление событий А не изменяет вероятности появления событий В, равно как и появление событий В не изменяет вероятности событий А, то события А и В считаются независимыми. Для таких событий Р(А/В) = Р(А), Р(В/А) = Р(В) и Р(А×В) = Р(А)×Р(В).

Пример. Вытащим одну карту из колоды (52 карты). Пусть событие А - появление туза, событие В -появление пиковой масти.

Р(А) = 4/52. Р(В) = 13/52. Р(АВ) = 1/52. Р(АВ) = Р(А)Р(В) = (4/52)(13/52) = 1/52.

События А и В независимы.

В общем случае, группы событий А, В, ... N считаются независимыми в совокупности в том и только в том случае, если выполняется равенство:

P(A×B× ... ×N) = P(A)×P(B)× ... ×P(N). (8.2.13)

Подмножества, образованные из независимых событий, также являются независимыми. Если условие (8.2.13) не выполняется, но выполняется для каждой пары событий из этой группы (А×В, А×С, В×С и пр.), то такие события называются попарно независимыми.

Формула полной вероятности. Систему событий А1, А2, ...,AN называют конечным разбиением (или просто разбиением), если они попарно несовместны, а их сумма образует полное пространство событий:

А1 + А2 + ... + АN = W. (2.2.14)

Если события Аi образуют разбиение пространства событий и все P(Ai) > 0, то для любого события В имеет место формула полной вероятности:

P(B) = P(Ak)×P(B/Ak), (8.2.15)

P(Ak)×P(B/Ak), (8.2.15)

что непосредственно следует из (8.2.14) для попарно несовместных событий:

B = B×W = BA1+BA2+...BAN.

P(B) = P(BA1)+P(BA2)+... +P(BAN) = P(A1)P(B/A1)+P(A2)P(B/A2)+...+P(AN)P(B/AN).

Пример. B урне находится N шаров, М белых и N-M черных. Событие А - первый вынутый шар белый, который в урну не возвращается. Какова вероятность события В, что второй вынутый шар будет белым?

Р(А) = M/N. Р( ) = (N-M)/N. Р(В/A) = (M-1)/(N-1). Р(В/

) = (N-M)/N. Р(В/A) = (M-1)/(N-1). Р(В/ ) = M/(N-1).

) = M/(N-1).

Отсюда: Р(В) = Р(А)Р(В/А) + Р( )Р(В/

)Р(В/ ) = M/N, т.е. Р(В) = Р(А). Аналогично можно вычислить вероятность события С, что третий вынутый шар будет белым, и так далее, причем все вероятности вынуть белый шар на любой попытке равны M/N.

) = M/N, т.е. Р(В) = Р(А). Аналогично можно вычислить вероятность события С, что третий вынутый шар будет белым, и так далее, причем все вероятности вынуть белый шар на любой попытке равны M/N.

Этот результат давно известен и применяется, например, при жеребьевке, определяя независимость результатов жеребьевки от порядка ее участников при вынимании шаров.

Формула Байеса (или формула гипотез). Если для пространства событий Ai выполнено условие (8.2.14) и для произвольного события В имеет место формула полной вероятности (8.2.15), то одновременно для любой комбинации событий В и Аk имеет место и формула умножения вероятностей (8.2.12)

Р(АkВ) = Р(Аk)×Р(В/Аk) º Р(В)×Р(Аk/В),

из которой следует:

Р(Аk/В) = Р(Аk)×Р(В/Аk) / Р(В).

Заменяя в этом уравнении выражение Р(В) формулой полной вероятности (8.2.15), получаем формулу Байеса:

Р(Аk/В) = Р(Аk)×Р(В/Аk) / P(Ak)×P(B/Ak). (8.2.16)

P(Ak)×P(B/Ak). (8.2.16)

Нетрудно видеть, что знаменатель функции является нормировочным коэффициентом приведения суммы вероятностей к 1:

Р(Аk/В) =

Р(Аk/В) =  Р(Аk)×Р(В/Аk) /

Р(Аk)×Р(В/Аk) / P(Ak)×P(B/Ak) = 1

P(Ak)×P(B/Ak) = 1

Смысл формулы Байеса заключается в следующем. Пусть Ak - возможные состояния (гипотезы) события А, для которых предполагается определенная плотность распределения вероятностей P(Ak). Событие В - результат некоторого единичного измерения (опыта), при этом известны условные вероятности P(B/Ak) реализации событий В по гипотезам Ak. Формула Байеса позволяет уточнить значения вероятностей реализации событий Ak по результатам испытания с реализацией события В. Другими словами, если P(Ak) - априорная плотность распределения вероятностей событий Ak, то P(Ak/B) - апостериорная плотность распределения вероятностей событий Ak, уточненная по результатам опыта, исходом которого явилось событие В.

Пример. В одном районе "дикого" туризма прогнозирование количества А несчастных случаев на следующие сутки проводилось по следующей методике (для наглядности рассмотрим пример на конкретных условных данных).

Априорные вероятности P(Аk) несчастных случаев на текущий день, вычисленные по предыдущему дню: P(А1=0) = 0.2, P(А2=1) = 0.4, P(А3=2) = 0.3, P(А4=3) = 0.1.

За текущий день зарегистрировано 0 несчастных случаев (В = 0).

Условные вероятности P(B/Ak) вычислялись по формуле плотности распределения вероятностей редких событий (формула Пуассона): P(B/Ak) = (Ak)B×exp(-Ak) /B!

P(0/0) = 1, P(0/1) = 0.368, P(0/2) = 0.135, P(0/3) = 0.05.

Нормировочный делитель формулы Байеса:  P(Ak)×P(B/Ak) = 0.393.

P(Ak)×P(B/Ak) = 0.393.

Апостериорные вероятности P'(Ak) = P(Ak/B) = P(Ak/0) несчастных событий на следующий день:

P'(А1=0) = 0.509, P'(А2=1) = 0.375, P'(А3=2) = 0.103, P'(А4=3) = 0.013.

Проверка:  P'(Ak) = 1.

P'(Ak) = 1.

8.3. Случайные величины [л30,л31,л2,л4,л15].

Общие понятия. Под случайной величиной в узком смысле данного термина можно понимать числовое отображение исхода случайного явления или опыта, если в основе его формирования лежат определенные физические процессы, вероятностные по свое природе. Так, например, число гамма-квантов, зарегистрированных радиометром за произвольный временной интервал от радиоактивной пробы, является случайной величиной как в силу вероятностной природы самого радиоактивного распада, так и в силу вероятностного характера их распространения, рассеяния и поглощения в окружающей среде и в детекторе радиометра.

|

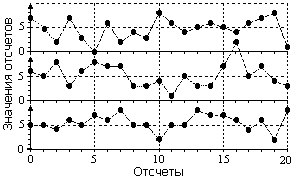

Рис. 8.3.1. |

С общих позиций под случайной величиной и, соответственно, случайным сигналом ее отображения, понимают результаты фиксации такого явления (процесса), которые являются либо полностью непредсказуемыми, либо предсказуемы только "в среднем", с определенной средней квадратической погрешностью. Конкретный результат, зарегистрированный в определенном опыте, называют реализацией случайного явления. Отдельную реализацию случайного явления нельзя описать явной математической формулой, равно как и предсказать значения этой реализации в какие-либо моменты ее координатного распределения, т.к. она является одной из множества возможных. Множество реализаций, зарегистрированных в одних и тех же условиях для одного и того же объекта, называют ансамблем реализаций (или выборкой из генеральной совокупности - полного множества всех возможных значений). В качестве примера на рис. 8.3.1 приведено 3 реализации отсчетов радиометра, которые проводились в постоянных условиях по 20-ти секундным интервалам с односекундной экспозицией. Ансамбль реализаций позволяет характеризовать случайное явление определенными и достаточно устойчивыми статистическими данными.

Еще раз отметим, что отнесение тех или иных величин и отображающих их сигналов к случайным или неслучайным (детерминированным) в той или иной мере всегда относительно, особенно в геофизической практике. С одной стороны, ни в одной сколь угодно точно известной геологической обстановке нельзя исключить появления объекта или проявления какого-либо процесса, которые совершенно непредсказуемым образом могут повлиять на распределение информационного сигнала. С другой стороны можно отрицать и истинную случайность физических явлений и процессов, поскольку по мере накопления информации появляется возможность их описания все более точными математическими формулами детерминированного действия.

Множество возможных значений случайной величины принято называть пространством (множеством) состояний (генеральной совокупностью). Если пространство состояний образует континуум, то случайная величина является непрерывной. Если изменение состояний допускается для конечного (счетного) числа координат, то говорят о случайной непрерывной последовательности.

Случайную величину с конечным множеством состояний по непрерывной шкале координат называют дискретной, если она дискретна по множеству своих возможных значений. Если для случайного явления изменение состояний возможно только в конечном числе координат, то говорят о случайной дискретной последовательности. Для случайных явлений с дискретным множеством состояний статистические зависимости могут распространяться на ограниченное число k следующих друг за другом значений. Такие процессы называются марковскими k-го порядка.

Вероятности случайных величин. Исчерпывающим описанием случайных величин является плотность распределения вероятностей p(x) (кратко - плотность вероятностей) которая определяет вероятность реализации некоторого значения Xi в элементарном интервале значений dx:

p(x)dx = P(x < Xi £ x+dx). (8.3.1)

Основные свойства плотности вероятностей:

1. p(x) ³ 0, - ¥ < x < ¥. Плотность вероятностей не отрицательна.

2.  p(x) dx = 1. Сумма вероятностей всех возможных значений случайной величины по данному пространству состояний должна быть равна 1, т.е. реализация одного из состояний должна быть достоверным событием.

p(x) dx = 1. Сумма вероятностей всех возможных значений случайной величины по данному пространству состояний должна быть равна 1, т.е. реализация одного из состояний должна быть достоверным событием.

3.  p(x) dx = P(x1<X£x2). Интеграл от плотности вероятностей по определенному интервалу равен вероятности реализации случайной величины в этом интервале значений.

p(x) dx = P(x1<X£x2). Интеграл от плотности вероятностей по определенному интервалу равен вероятности реализации случайной величины в этом интервале значений.

4. Функция P(x) =  p(u) du определяет вероятность того, что значения случайной величины меньше или равны значению х.

p(u) du определяет вероятность того, что значения случайной величины меньше или равны значению х.

Функция P(x) носит название функции распределения вероятностей (кратко - распределение вероятностей). Соответственно, производная от функции распределения вероятностей есть плотность вероятностей. Основные свойства функции распределения вероятностей:

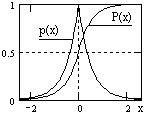

|

Рис. 8.3.2. |

1. Интервал определения функции: 0 £ P(x) £ 1, - ¥ < x < ¥.

2. P(-¥) = 0, P(¥) = 1.

3. P(x) не уменьшается при возрастании х.

4. P(x1<X £ x2) = P(x2) - P(x1).

На рис. 8.3.2 приведен пример функции плотности вероятностей p(x) = (a/2)exp(-a|x|) и соответствующей функции вероятностей P(x).

Аналогичным описанием для случайных дискретных величин является непосредственно дискретное распределение вероятностей их значений:

Pi(x) = P(xi < Xi £ xi+1),  P(xi) = 1.

P(xi) = 1.

|

Рис. 8.3.3. |

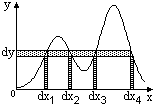

Функции от случайной величины. Допустим, что случайная величина Y связана со случайной величиной Х однозначной зависимостью y = f(x) (рис. 8.3.3). Интервалам dx соответствуют интервалы |dy| = |f'(x)|dx, при этом вероятности случайных величин в этих интервалах должны быть равны: px(x)dx = py(y)|dy|. Отсюда следует:

py(y) = px(x)|dx/dy|, (8.3.2)

где аргумент х в правой части выражения должен быть выражен через x = g(y) - функцию, обратную y = f(x). Выполняя последнее, получаем:

py(y) = px[g(y)]|dg(y)/dy|, (8.3.2')

Значения |dy| и последующие значения |dx/dy| и |dg(у)/dy| принимаются по модулю для исключения отрицательных значений в функции py(y), которых не может быть по определению и физической сущности плотности распределения вероятностей.

|

Рис. 8.3.4. |

Если связь между значениями Х и Y неоднозначна, как, например, на рис. 8.3.4, и значению у может соответствовать несколько значений х, то вероятность попадания случайной величины у в интервал dy будет складываться из суммы вероятностей несовместных событий px(x1)dx1 + px(x2)dx2 + ..., откуда следует:

py(y) =  pi(xi)|dxi/dy| =

pi(xi)|dxi/dy| =  px[gi(y)]|dgi/dy|, (8.3.2'')

px[gi(y)]|dgi/dy|, (8.3.2'')

Пример. Связь случайных величин Х и Y задана выражением Y = aX+b. Плотность вероятностей величины Х соответствует распределению Гаусса:  . Из уравнения связи величин Y и X имеем x = (y-b)/a и |dx/dy| = 1/|a|, и соответственно получаем:

. Из уравнения связи величин Y и X имеем x = (y-b)/a и |dx/dy| = 1/|a|, и соответственно получаем:

,

,  = b+

= b+ a, sу2 = а2 sх2

a, sу2 = а2 sх2

Моменты распределения. При решении многих практических задач нет особой необходимости в полной вероятностной характеристике каких-либо случайных величин, которую дает функция плотности распределения вероятностей. Очень часто приходится также иметь дело с анализом случайных величин, плотности вероятностей которых не отображаются аналитическими функциями либо вообще неизвестны. В этих случаях достаточно общее представление о характере и основных особенностях распределения случайных величин можно получить на основании усредненных числовых характеристик распределений.

Числовыми характеристиками случайных величин, которые однозначно определяются функциями распределения их вероятностей, являются моменты.

Начальные моменты n-го порядка случайной величины X (или просто моменты) представляют собой усредненные значения n-й степени случайной переменной:

mn º М{Xn}º  =

=  xn p(x) dx, (8.3.3)

xn p(x) dx, (8.3.3)

где M{Xn} и  - символические обозначения математического ожидания и усреднения величины Хn, которые вычисляются по пространству состояний случайной величины Х.

- символические обозначения математического ожидания и усреднения величины Хn, которые вычисляются по пространству состояний случайной величины Х.

Соответственно, для случайных дискретных величин:

mn º М{Xn}º  =

= xin pi. (8.3.3')

xin pi. (8.3.3')

Центральные моменты n-го порядка, это моменты относительно центров распределения (средних значений) случайных величин:

mn º M{(X- )n}º

)n}º  =

= (x-m1)n p(x) dx, (8.3.4)

(x-m1)n p(x) dx, (8.3.4)

mn º M{(X- )n}º

)n}º  =

= (xi-m1)n pi, (8.3.4')

(xi-m1)n pi, (8.3.4')

где  - начальный момент 1-го порядка (среднее значение величины Х), X0 = X-

- начальный момент 1-го порядка (среднее значение величины Х), X0 = X- - центрированные значения величины Х.

- центрированные значения величины Х.

Связь между центральными и начальными моментами достаточно проста:

m1=0, m2=m2-m12, m3=m3-3m2m1+2m13, m4=m4-4m1m3+6m12m2-3m14, и т.д.

Соответственно, для случайных величин с нулевыми средними значениями начальные моменты равны центральным моментам.

По результатам реализации случайных величин может производиться только оценка моментов, т.к. количество измерений всегда конечно и не может с абсолютной точностью отражать все пространство состояний случайных величин. Результаты измерений - выборка из всех возможных значений случайной величины (генеральной совокупности). Оценка моментов, т.е. определение средних значений n-й степени по выборке из N зарегистрированных значений, производится по формулам:

= (1/N)

= (1/N) xin »

xin »  ,

,  = (1/N)

= (1/N) (xi-

(xi- )n »

)n »  . (8.3.5)

. (8.3.5)

Погрешность оценок стремится к нулю при выборке N Þ ¥.

Основные числовые характеристики случайных величин - это начальный момент 1-го порядка (средние значение распределения случайных величин) и центральный момент 2-го порядка (дисперсия распределения).

Среднее значение распределения является характеристикой сдвига значений случайных величин относительно x = 0 и представляет собой значение центра рассеяния случайных величин, т.е. математическое ожидание случайной величины по пространству возможных состояний:

M{X}º =

= x p(x) dx,

x p(x) dx,  =

= xn P(xn). (8.3.6)

xn P(xn). (8.3.6)

Если пространство возможных состояний случайных величин ограничено определенными конечными пределами, то соответственно интегрирование (или суммирование) осуществляется в этих пределах. В функциях от случайных величин постоянный множитель можно выносить за знак математического ожидания:

M{Y}= M{c×X} = c×M{X}.

Оценка среднего значения по результатам N-выборки (выборочное среднее):

= (1/N)

= (1/N) xi (8.3.7)

xi (8.3.7)

Значение  генеральной совокупности случайной величины Х является неслучайной величиной, в отличие от значения выборочного среднего

генеральной совокупности случайной величины Х является неслучайной величиной, в отличие от значения выборочного среднего  , которое также является величиной случайной. Математическое ожидание величины

, которое также является величиной случайной. Математическое ожидание величины  с использованием формулы (8.3.7):

с использованием формулы (8.3.7):

M{ } = (1/N) M{

} = (1/N) M{ xi} = (1/N) M{N×xi} = M{X} =

xi} = (1/N) M{N×xi} = M{X} =  .

.

Отсюда следует, что выборочное среднее есть несмещенная оценка среднего значения генеральной совокупности, т.е.  »

»  .

.

Дисперсия распределения характеризует размер пространства состояний случайной величины, величину их рассеивания по значениям относительно среднего значения:

D{X}º M{(X- )2}º M{X02}=

)2}º M{X02}= (x-

(x- )2 р(x) dx. (8.3.8)

)2 р(x) dx. (8.3.8)

Оценка дисперсии по результатам N-выборки производится по формулам:

Dx = (1/N) (xi-

(xi- )2 » D{X}. (8.3.9)

)2 » D{X}. (8.3.9)

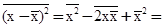

Dx º

-

-  2. (8.3.9')

2. (8.3.9')

Для функции с×Х, где с = const, имеем:

D{c×X}=M{(cX-M{cX})2}=M{(cX-cM{X})2}=M{c2(X-M{X})2}=c2×D{X}.

Среднее квадратическое отклонение случайной величины от математического ожидания (среднего значения), равное корню квадратному из значения дисперсии:

sх =  , (8.3.10)

, (8.3.10)

получило название стандарта (стандартного отклонения). Величину стандарта в относительных единицах среднего значения dx = s/mx называют вариацией или (в основном для временных процессов) флюктуацией значений случайной величины.

Пример. Плотность распределения случайных величин Х: p(x) = (a/2)exp(-a|x-b|), а=2, b=4.

Среднее значение и дисперсия:  =

= x p(x) dx = b = 4, D{X} =

x p(x) dx = b = 4, D{X} = (x-b)2 р(x) dx = 2/a2 = 0.5.

(x-b)2 р(x) dx = 2/a2 = 0.5.

В опыте зарегистрированы: Х = {2.75, 4.08, 3.9, 3.82, 3.68, 3.03, 4.16, 5.74, 3.78, 2.77, 4.03}.

Среднее значение и дисперсия по выборке:

= (1/11)

= (1/11) xi = 3.79,

xi = 3.79,  = (1/11)

= (1/11) xi2 = 15, Dx =

xi2 = 15, Dx =  -

-  2 = 0.62.

2 = 0.62.

Погрешность оценок выборочных средних значений  в зависимости от N - размеров выборки вычисляется по дисперсии значений

в зависимости от N - размеров выборки вычисляется по дисперсии значений  (выражение (8.3.7)):

(выражение (8.3.7)):

D( ) = D((1/N)

) = D((1/N) xi) = (1/N2) D(

xi) = (1/N2) D( xi) = (1/N) D(xi),

xi) = (1/N) D(xi),

т.е. дисперсия средних значений  по N-выборке в N раз меньше дисперсии самих значений случайных величин Х. Соответственно, точность оценки средних значений

по N-выборке в N раз меньше дисперсии самих значений случайных величин Х. Соответственно, точность оценки средних значений  определится выражением:

определится выражением:

s( ) = sx/

) = sx/ .

.

Точность оценки выборочного среднего значения случайных величин возрастает пропорционально корню квадратному из размеров выборки. По мере увеличения объема выборки выборочное среднее значение стремится к математическому ожиданию случайной величины как к своему пределу (закон больших чисел). В математической статистике доказывается также, что если случайная величина Х имеет среднее значение  и конечную дисперсию sx2, то при стремлении объема выборки N к бесконечности распределение выборочного среднего

и конечную дисперсию sx2, то при стремлении объема выборки N к бесконечности распределение выборочного среднего  будет стремиться к нормальному закону со средним значением

будет стремиться к нормальному закону со средним значением  и дисперсией sx2/N (центральная предельная теорема).

и дисперсией sx2/N (центральная предельная теорема).

К числовым характеристикам случайных величин Х относятся также мода Мох, медиана Мех, асимметрия Sх и эксцесс Ех.

|

Рис. 8.3.5. |

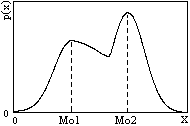

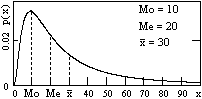

Мода распределения - это наиболее вероятное значение случайных величин, которому соответствует максимум плотности вероятностей. Функции плотности вероятностей могут иметь больше одного максимума. Такие распределения называют много- или полимодальными. На рис. 8.3.5 приведен пример двумодального распределения.

Для одномодальных распределений, симметричных относительно среднего значения, мода совпадает со средним значением, для асимметричных среднее значение обычно смещено относительно моды в сторону более длинного "хвоста" изменения плотности вероятностей.

|

Рис. 8.3.6. |

Медиана распределения случайных величин Мех - это такое число (значение Х), относительно которого площади под функцией плотности вероятностей слева и справа равны друг другу, т.е.:

Р(X<Mex) = Р(X>Mex) = 0.5.

Понятие медианы обычно используется для непрерывных случайных величин.

В резко асимметричных распределениях случайных величин значения моды, медианы и среднего значения существенно расходятся, как, например, для логнормального распределения на рис. 8.3.6.

|

Рис. 8.3.7. |

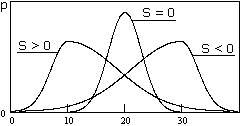

Асимметрия (или скошенность) распределения случайных величин X - это безразмерное число, которое определяется выражением:

Sx = m3/sx3 º M{(X- )3/sx3 º

)3/sx3 º  /sx3.

/sx3.

При Mox < Mex асимметрия положительна (распределение вытянуто вправо, S > 0), при Mox > Mex - отрицательна. Для симметричных распределений Mox = Mex = и асимметрия равна нулю. На рис. 8.3.7 приведены плотности вероятностей случайных величин с разной асимметрией.

и асимметрия равна нулю. На рис. 8.3.7 приведены плотности вероятностей случайных величин с разной асимметрией.

|

Рис. 8.3.8. |

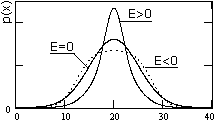

Эксцесс (или крутость) распределения случайных величин также безразмерное число:

Ex = m4/sx4 - 3 º M{(X- )4/sx4 -3 º

)4/sx4 -3 º  /sx4 - 3.

/sx4 - 3.

Эксцесс характеризует форму функции плотности вероятностей по отношению к форме функции нормального распределения (см. ниже, выражение 8.3.15), значение эксцесса для которого равно 0. Если кривая распределения имеет более острую и высокую вершину при той же величине дисперсии, то значение эксцесса больше нуля, если более низкую и пологую - меньше нуля (рис. 8.3.8).

Оценка числовых характеристик функций от случайных величин может производиться непосредственно по числовым характеристикам случайных величин с использованием правила переноса ошибок.

Допустим, что случайная величина Y является функционально зависимой от случайной величины Х и определяется выражением Y = g(x). Разложим это выражение в ряд Тейлора относительно математического ожидания  :

:

g(x) = g( ) + (x-

) + (x- )g'(

)g'( ) + (x-

) + (x- )2g''(

)2g''( )/2! + ... (8.3.11)

)/2! + ... (8.3.11)

Оценка математического ожидания  :

:

M{g(x)}= M{g( )}+M{(x-

)}+M{(x- )g'(

)g'( )}+M{(x-

)}+M{(x- )2g''(

)2g''( )/2!}= g(

)/2!}= g( ) + 0 + sx2g''(

) + 0 + sx2g''( )/2! +...

)/2! +...

Отсюда, с точностью до членов второго порядка малости:

= g(

= g( ). (8.3.12)

). (8.3.12)

Оценка дисперсии распределения D(g(x)) = Dy:

Dy = M{[g(x) - M{g(x)}]2} » M{[g(x)-g( )]2}. (8.3.13)

)]2}. (8.3.13)

Из формулы (8.3.11) имеем:

g(x) - g( ) = (x-

) = (x- )g'(

)g'( ) + (x-

) + (x- )2g''(

)2g''( )/2! + ...

)/2! + ...

С использованием этого выражения в (8.3.13) с ограничением до 2-го порядка:

Dy » M{[(x- )g'(

)g'( )]2} = [g'(

)]2} = [g'( )]2×Dx. (8.3.14)

)]2×Dx. (8.3.14)

sy = g'( )×sx, dy = g'(

)×sx, dy = g'( )×dx.

)×dx.

Для линейных функций g(x) ~ a×x+b выражения (8.3.12-14) являются точными.

Некоторые распределения случайных величин.

|

Рис. 8.3.9. |

Равномерное распределение. Случайная величина равновероятна в интервале значений от х1 до х2 (рис. 8.3.9):

р(х) = 1/(х2-х1), х1 £ х £ х2,

= 0, х < х1, х > х2.

М{X}= (х1+х2)/2, D{X}= (x2-x1)2/12.

Для дискретной величины с N равноотстоящими друг от друга значениями:

Pi = 1/N, M{X} = (x1+x2)/2, D{X} = [(x2-x1)2/12][(N+1)/(N-1)].

|

Рис. 8.3.10. |

Распределение Гаусса (нормальное распределение). Плотность вероятностей нормального распределения случайных непрерывных величин Х задается двумя параметрами - среднего значения  (центра распределения) и дисперсии s2:

(центра распределения) и дисперсии s2:

. (8.3.15)

. (8.3.15)

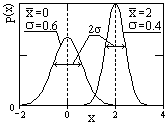

Пример двух распределений Гаусса при разных средних значениях и дисперсиях приведен на рис. 8.3.10.

Плотность вероятностей случайной гауссовской величины имеет только один максимум, который соответствует x =  , т.е. математическому ожиданию, при этом форма распределения симметрична относительно математического ожидания. При |х| Þ ¥ ветви кривой асимптотически приближаются к нулю. Изменение математического ожидания при s = const смещает максимум распределения вдоль оси х без изменения формы кривой. Ширина плотности вероятностей распределения пропорциональна стандартному отклонению s и на уровне 0.607 от максимального значения p(x) равна 2s. Вероятность отклонений значений х от среднего значения

, т.е. математическому ожиданию, при этом форма распределения симметрична относительно математического ожидания. При |х| Þ ¥ ветви кривой асимптотически приближаются к нулю. Изменение математического ожидания при s = const смещает максимум распределения вдоль оси х без изменения формы кривой. Ширина плотности вероятностей распределения пропорциональна стандартному отклонению s и на уровне 0.607 от максимального значения p(x) равна 2s. Вероятность отклонений значений х от среднего значения  на величины, большие 3s, в нормальных распределениях равна 0.0028, что позволяет выполнять прямые и обратные прогнозные оценки:

на величины, большие 3s, в нормальных распределениях равна 0.0028, что позволяет выполнять прямые и обратные прогнозные оценки:

xmax @  + 3s, xmin @

+ 3s, xmin @  - 3s,

- 3s,

@ (xmax+xmin)/2, s @ (xmax-xmin)/6.

@ (xmax+xmin)/2, s @ (xmax-xmin)/6.

Нормальное распределение играет большую роль в теории вероятностей и в математической статистике. Основная особенность его заключается в том, что оно является предельным законом, к которому при определенных условиях приближаются другие законы распределения. В частности, независимые случайные величины Х1, Х2, ..., Хn, подчиненные каким угодно законам распределения (с весьма небольшими исключениями), при суммировании и других линейных комбинациях дают распределения, сколь угодно близкие к нормальному закону. Это позволяет нормальному распределению служить хорошей математической моделью для большинства многофакторных физических процессов. Линейные комбинации случайных гауссовских величин всегда являются гауссовскими.

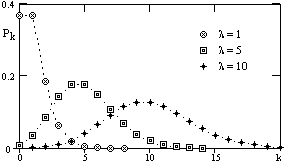

Распределение Пуассона является широко распространенным распределением случайных целочисленных дискретных величин. Оно задается только одним параметром l, значение которого равно среднему значению случайных величин распределения и одновременно задает значение дисперсии распределения:

Pk =  , k - целое. (8.3.16)

, k - целое. (8.3.16)

= l, Dk = l, sk =

= l, Dk = l, sk = , dk = 1/

, dk = 1/ .

.

Распределение Пуассона иногда называют распределением вероятностей количества редких событий, для оценки которых оно и применяется наиболее часто, безотносительно к их физической сущности. Условия справедливости распределения Пуассона применительно к каким-либо случайным явлениям (событиям) достаточно просты:

1. Случайная величина может принимать только нулевые и целые положительные значения (как, например, число отказов аппаратуры или телефонных звонков за определенный временной интервал, число треков от альфа-частиц на площади или в объеме трекового детектора и т.п.).

2. Вероятность отдельного события на бесконечно малом пространстве счета событий, на котором ведется их регистрация (время, площадь, объем и пр.) пропорциональна величине этого пространства и при его стремлении к нулю также стремится к нулю, как бесконечно малая первого порядка, а вероятности событий более высокой кратности (2 и более событий) стремятся к нулю, как бесконечно малые более высоких порядков.

3. События в неперекрывающихся интервалах пространства счета событий статистически независимы.

|

Рис. 8.3.11. |

Пример. Средняя скорость счета фоновых гамма-квантов детектором радиометра составляет m = 1 импульс в секунду. Возможные экспозиции единичного измерения равны 1, 5 и 10 секунд. Все три условия справедливости закона Пуассона для процесса регистрации квантов выполнены. Значение l для распределения (8.3.16) будет определяться выражением l = mT, где Т - экспозиция измерения. Расчетные значения вероятностей Pk для трех различных экспозиций приведены на рис. 8.3.11. Попутно заметим, что значение l для закона Пуассона не обязано быть целочисленным.

Как видно на рис. 8.3.11, распределение Пуассона резко асимметрично при малых значениях l. По мере роста l распределение становится симметричным относительно  = l и при l>20 может быть аппроксимировано однопараметровым распределением Гаусса с

= l и при l>20 может быть аппроксимировано однопараметровым распределением Гаусса с  = s2 = l.

= s2 = l.

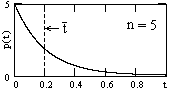

Экспоненциальное распределение. Этим законом отображается, например, распределение длительности интервалов между случайными событиями, соответствующими закону Пуассона, непосредственно из которого оно и может быть получено.

Допустим, что для рассматриваемого явления значение l распределения Пуассона определяется выражением l = nt, где n - среднее количество событий на единице интервала t (средняя скорость следования событий, если t - время). Длительность интервала между двумя последовательными событиями будет равна t+dt, если на интервале t не будет ни одного события (вероятность чего в соответствии с (8.3.16) равна Р0 = (nt)0×e-nt/0! = e-nt), а на интервале dt Þ 0 произойдет одно событие (вероятность P1 = (ndt)1×e-ndt/1! = ndt, так как e-ndt Þ 1 при dt Þ 0). События в неперекрывающихся интервалах являются статистически независимыми, а, следовательно, искомая вероятность p(t)dt интервала t будет равна произведению вероятностей Р0 и Р1, т.е. p(t)dt = e-nt×ndt, откуда получаем выражение для плотности распределения вероятностей случайной непрерывной величины t:

p(t) = n×e-nt, t ³ 0. (8.3.17)

|

Рис. 8.3.12. |

Пример распределения при n = 5 приведен на рис. 8.3.12. Распределение, как и положено, является нормированным:

p(t) dt = 1.

p(t) dt = 1.

Среднее значение длительности интервала:

=

=  t p(t) dt = n

t p(t) dt = n t e-nt dt = 1/n.

t e-nt dt = 1/n.

Среднее квадратическое значение:

=

=  t2 p(t) dt = n

t2 p(t) dt = n t2 e-nt dt = 2/n2.

t2 e-nt dt = 2/n2.

Дисперсия, среднее квадратическое отклонение и относительные флюктуации:

Dt =  -

- 2 = 1/n2, st =

2 = 1/n2, st =  = 1/n, dt = st/

= 1/n, dt = st/ = 1.

= 1.

Как видно на рис. 8.3.12, для распределения наиболее вероятны короткие интервалы, меньшие среднего значения интервалов. Соответственно, для выдерживания среднего значения  = 1/n, большее количество коротких интервалов компенсируется меньшим количеством, но длинных интервалов, в 2-3 и более раз превышающих средний интервал, что приводит к большим флюктуациям длины интервалов (среднее квадратическое отклонение равно средней длине интервалов). При работе с пуассоновскими распределениями это следует учитывать, так как длительное отсутствие регистрации событий в процессе единичной реализации какого-либо случайного процесса может вовсе не свидетельствовать об отсутствии самого процесса.

= 1/n, большее количество коротких интервалов компенсируется меньшим количеством, но длинных интервалов, в 2-3 и более раз превышающих средний интервал, что приводит к большим флюктуациям длины интервалов (среднее квадратическое отклонение равно средней длине интервалов). При работе с пуассоновскими распределениями это следует учитывать, так как длительное отсутствие регистрации событий в процессе единичной реализации какого-либо случайного процесса может вовсе не свидетельствовать об отсутствии самого процесса.

Характеристическая функция С(t) случайной величины Х с плотностью вероятностей р(х) определяется выражением:

C(v) =  p(x) exp(j2pvx) dx. (8.3.18)

p(x) exp(j2pvx) dx. (8.3.18)

Нетрудно заметить, что это выражение совпадает с обратным преобразованием Фурье функции р(х). Отсюда следует:

p(x) =  C(v) exp(-j2pvx) dv, (8.3.19)

C(v) exp(-j2pvx) dv, (8.3.19)

т.е. плотность вероятностей случайной величины может рассматриваться, как частотный спектр характеристической функции случайной величины, а последняя, в свою очередь, как координатное представление распределения случайной величины.

Через определение (или вычисление) характеристической функции упрощается нахождение моментов случайной величины любого порядка, а именно:

dnC(v)/dvn = jn xn p(x) exp(j2pvx) dx.

xn p(x) exp(j2pvx) dx.

Принимая v = 0 и сравнивая результат с выражением (8.3.3), получаем:

mn = j-n dnC(0)/dvn = j-n C(n)(0). (8.3.20)

С помощью характеристической функции и выражений (8.3.2) можно также находить плотность вероятностей случайных величин, подвергнутых функциональным преобразованиям.

8.4. Системы случайных величины [л31,л2,л4,л15].

Свойства случайных сигналов принято описывать характеристиками совокупности случайных величин {Х1,Х2,...,Xn}, которую называют также системой или совместным распределением случайных величин. Система реализуются в процессе совместных измерений или в процессе последовательных измерений одной реализации. И в том, и в другом случае совместное распределение величин может рассматриваться как n-мерный случайный вектор Х. Теория систем случайных величин наиболее детально разработана для двух случайных величин, измеряемых по одной координате (времени, пространству и т.п.).

Пример 1. Результат накопления информации в каналах многоканального спектрометра от датчика ионизирующего излучения представляет собой совокупность (систему) случайных величин Xi (i = 1,2,...,k - номер канала спектрометра), каждая из которых распределена по закону Пуассона. Результат единичной экспозиции измерений (единичной реализации системы) - совместное распределение отсчетов xi. В совокупности эти отсчеты представляют собой k-мерный случайный вектор Х как реализацию случайного сигнала - определенного спектрального распределения излучения с математическим ожиданием отсчетов в каналах M{Xi}.

Пример 2. По стволу скважины с шагом дискретизации данных 10 см зарегистрирована цифровая диаграмма ГК - мощности экспозиционной дозы гамма-излучения пород. Последовательность цифровых отсчетов xi диаграммы (i = 1,2,...k) в силу природы радиоактивного распада представляет собой одну реализацию случайных величин Xi (k-мерный случайный вектор Х).

Пример 3. Дополнительно к мощности экспозиционной дозы в примере 2 по стволу скважины зарегистрированы цифровые диаграммы гамма-гамма-каротажа (ГГК) yi, нейтронного каротажа (НК) ni и нейтронного гамма-каротажа (НГК) zi. Эти диаграммы также могут рассматриваться как единичные реализации систем случайных величин соответственно Yi, Ni и Zi. Но одновременно однономерные совокупности случайных величин xi, yi, ni и zi (пространственные сечения) также могут рассматриваться в виде 4-х мерных систем случайных величин Xi, Yi, Ni и Zi, зарегистрированных последовательно по одной пространственной координате, равно как и в виде одной 5-ти мерной системы случайных величин X, Y, N, Z (5-ти мерный случайный вектор или 5-ти мерный случайный сигнал).

|

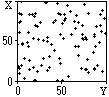

Рис. 8.4.1. |

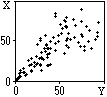

При рассмотрении систем случайных величин, и особенно дву- и трехмерных, удобно использовать геометрическую интерпретацию систем. Так, например, пространство системы двух случайных величин (X,Y) можно представлять себе на плоскости x0y с координатами X и Y, где каждой паре (xi,yi) реализации случайных величин соответствует точка на плоскости. На рис. 8.4.1 приведен пример такого графического отображения реализаций системы независимых случайных величин (X,Y). Аналогично в трехмерном пространстве могут отображаться трехмерные системы случайных величин.

Рассмотрение систем случайных величин будем проводить, в основном, на двумерных системах, основные положения которых легко распространяются и на многомерные системы.

Функция распределения вероятностей системы (n-мерное совместное распределение вероятностей) определяет вероятность реализации системы событий Х, как появления событий {Х1,Х2,...,Xn} в одной реализации:

P(x1,x2, ... ,xn) = P(X1 £ x1, X2 £ x2, ... ,Xn £ xn). (8.4.1)

|

Рис. 8.4.2. |

Геометрически (рис. 8.4.2) функция распределения системы двух случайных величин (X,Y) представляет собой вероятность реализации случайных точек в левом нижнем бесконечном квадранте (заштриховано) с вершиной в точке (x,y).

Свойства многомерной функции распределения в целом аналогичны одномерной функции и кратко могут быть описаны следующим образом:

1. 0 £ P(x1,x2, ... ,xn) £ 1, -¥ <x1< ¥, -¥ <x2< ¥ , ... , -¥ <xn< ¥.

2. P(x1,x2, ... ,xn) есть монотонно неубывающая функция по всем xi.

3. P(x1,x2, ... ,xn) = 0, если хотя бы один из аргументов равен - ¥.

4. P(x1,x2, ... ,xn) = 1, если все без исключения аргументы равны ¥.

|

Рис. 8.4.3. |

5. P( ¥,x2, ... ,xn) = P1(x2, ... ,xn), P(x1,¥, ... ,xn) = P2(x1,x3, ... ,xn), ... и т.д. для любых значений xi = ¥ в любых комбинациях вплоть до P(¥,¥, ... ,xn) = Pj(xn), при этом функции Pi для разных комбинаций аргументов не обязаны иметь один и тот же вид. Геометрическое отображение данного свойства для двумерной системы (X,Y) приведено на рис. 8.4.3.

Плотность вероятностей системы удовлетворяет соотношению:

p(x1,x2,...,xn) dx1 dx2 ... dxn = P{x1<X1£x1+dx1, ... ,xn<Xn£xn}. (8.4.2)

p(x1,x2,...,xn) =  P(x1,x2, ... ,xn) /

P(x1,x2, ... ,xn) / . (8.4.3)

. (8.4.3)

|

Рис. 8.4.4. |

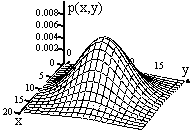

Плотность вероятностей двумерной системы можно изобразить геометрически в виде поверхности распределения вероятностей, пример которой приведен на рис. 8.4.4.

Свойства многомерной плотности распределения вероятностей вытекают из свойств функции распределения вероятностей и в целом аналогичны одномерной плотности вероятностей, а именно (на примере двумерной плотности вероятностей):

1. p(x,у) ³ 0, - ¥ < x < ¥, - ¥ < x < ¥. Плотность вероятностей не отрицательна.

2.

p(x,у) dx dy = 1. Сумма вероятностей всех возможных значений системы случайных величин (X,Y) по пространству состояний равна 1.

p(x,у) dx dy = 1. Сумма вероятностей всех возможных значений системы случайных величин (X,Y) по пространству состояний равна 1.

3.

p(x,y) dx dy = P(x1<X£x2, y1<Y£y2). Двойной интеграл от плотности вероятностей по определенным интервалам случайных величин Х и Y равен вероятности реализации системы случайных величин в этом интервале значений Х и Y.

p(x,y) dx dy = P(x1<X£x2, y1<Y£y2). Двойной интеграл от плотности вероятностей по определенным интервалам случайных величин Х и Y равен вероятности реализации системы случайных величин в этом интервале значений Х и Y.

По известной n-мерной плотности вероятностей может определяться m-мерная плотность при m<n интегрированием по "лишним" координатам:

p(x1,x2,...,xm) = ...

...  p(x1,x2,...,xn) dxm+1 ... dxn. (8.4.4)

p(x1,x2,...,xn) dxm+1 ... dxn. (8.4.4)

Условные законы распределения. Выражение (8.4.4) при известном законе плотности распределения вероятностей системы случайных величин позволяет определить плотность вероятностей любой из случайных величин, входящих в систему. Обратная задача не может решаться столь просто, поскольку известные законы распределения отдельных случайных величин не определяют связей между величинами, если последние существуют. Для решения задачи требуется задание условных законов распределения, т.е. плотности распределения вероятностей одной случайной величины при определенных значениях других случайных величин.

Случайные величины, входящие в систему, реализуются совместно. С учетом этого, условные законы распределения случайных величин можно получить переходом от условных вероятностей совместных событий (8.2.10-12) к плотности распределения вероятностей. В общем случае, условные законы распределения также могут быть многомерными, т.е. определять вероятность реализации одной из случайных величин при условии реализации определенных значений других величин системы. Однако на практике даже для многомерных систем используются, в основном, попарные двумерные зависимости. Так, для двумерных случайных систем условные плотности вероятностей величины X по значениям величины Y и величины Y по Х определяются выражениями:

p(x/y) = p(x,y)/p(y), p(y/x) = p(x,y)/p(x). (8.4.5)

Отсюда, определение плотности вероятностей двумерной системы производится по формулам:

p(x,y) = p(x)×p(y/x) º p(y)×p(x/y). (8.4.6)

При известных многомерных законах распределений анализ попарных двумерных распределений производится с использованием выражения (8.4.4).

Функции регрессии. Из выражений (8.4.5-6) следует, что в системе зависимых случайных величин математические ожидания величин также являются зависимыми, т.е. функциями средних значений одной величины от значений другой величины:

(y) = M{X/y}=

(y) = M{X/y}= x p(x/y) dx,

x p(x/y) dx,  (x) = M{Y/x}=

(x) = M{Y/x}= y p(y/x) dy. (8.4.7)

y p(y/x) dy. (8.4.7)

Уравнения

x =  (y), y=

(y), y= (x) (8.4.8)

(x) (8.4.8)

называются уравнениями регрессии соответственно X по Y и Y по Х. В общем случае уравнения регрессии для многомерных систем также могут быть многомерными, типа x =  (y,z,...) и пр.

(y,z,...) и пр.

Статистическая независимость случайных величин. Для совместной системы случайных величин X случайные величины системы (X1, X2, ...) статистически независимы друг от друга, если реализация одной из величин ни каким образом не определяет и не влияет на реализацию других величин. Так, например, при игре в кости реализация в одном бросании числа на одном кубике не влияет на появление каких-либо чисел на других кубиках. Если такая зависимость появляется, то это свидетельствует о мошенничестве.

Статистически независимы, как правило, случайные величины, связанные с источниками различной физической природы. В строго корректном понимании данного термина случайные события статистически независимы тогда и только тогда, когда выполняется условие:

p(x1,x2,...,xn) = p1(x1) p2(x2) ... pn(xn). (8.4.9)

Пример. Определить независимость случайных величин Х и Y в двумерной системе по заданной плотности распределения вероятностей системы.

1. p(x,y) = 1/[p2(1+x2+y2+x2y2)]. Выражение 1+x2+y2+x2y2 может быть разделено по переменным на множители (1+х2)(1+у2), а, следовательно, p(x,y) = p(x)×p(y). Случайные величины Х и Y независимы.

2. p(x,y) = x+y, 0 £ x £ 1, 0 £ y £ 1. Cоответствующие одномерные плотности вероятностей:

p(x) =  (x+y) dy = x+1/2, p(y) =

(x+y) dy = x+1/2, p(y) = (x+y) dx = y+1/2. p(x,y) ¹ p(x)×p(y). Величины Х и Y зависимы.

(x+y) dx = y+1/2. p(x,y) ¹ p(x)×p(y). Величины Х и Y зависимы.

Условные плотности вероятностей по (8.4.5): p(x/y) = (x+y)/(y+0.5), p(y/x) = (x+y)/(x+0.5).

Моменты систем случайных величин. Вычисление моментов случайных величин с использованием многомерной плотности вероятностей может производиться как по отдельным величинам Xi, так и на любые их комбинации (смешанные моменты). Так, вычисление средних значений и дисперсий любых случайных величин, входящих в n-мерную систему, производится по формулам:

=

= ...

... xi p(x1,x2,...,xn) dx1dx2...dxn, (8.4.10)

xi p(x1,x2,...,xn) dx1dx2...dxn, (8.4.10)

sxi2 = ...

... (xi-

(xi- )2 p(x1,x2,...,xi) dx1dx2...dxn. (8.4.11)

)2 p(x1,x2,...,xi) dx1dx2...dxn. (8.4.11)

Для случайных дискретных величин интегрирование соответственно заменяется суммированием, а плотности распределения вероятностей на распределения вероятностей.

Ковариация и корреляция. Смешанные начальные моменты второго порядка носят название ковариационных моментов системы случайных величин. Для двумерных систем:

R12 = M{X1X2}=  =

=

x1x2 p(x1,x2) dx1dx2. (8.4.12)

x1x2 p(x1,x2) dx1dx2. (8.4.12)

В общем случае, для n-мерной системы случайных величин:

Rij = M{XiXj}=  =

= ...

... xixj p(x1,x2,...,xn) dx1dx2...dxn, i,j = 1...n (8.4.13)

xixj p(x1,x2,...,xn) dx1dx2...dxn, i,j = 1...n (8.4.13)

|

Матрица Rij |

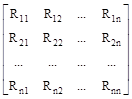

Значения моментов Rij образуют матрицу размером n ´ n попарной ковариации всех случайных величин, входящих в систему. С учетом того, что имеет место равенство Rij = Rji, ковариационная матрица (см. пример) симметрична относительно главной диагонали i = j, при этом ковариационные моменты на главной диагонали матрицы представляют собой средние значения квадратов случайных величин Xi, т.к.  = Rij при i = j.

= Rij при i = j.

|

Матрица Kij |

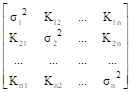

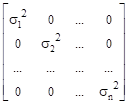

Смешанные центральные моменты второго порядка называют корреляционными моментами системы случайных величин. Они, как и ковариационные моменты, также образуют матрицу моментов системы, симметричную относительно главной диагонали, при этом значения моментов на главной диагонали представляют собой значения дисперсий si2 = Kij при i = j соответствующих случайных величин Xi (см. пример).

Kij = M{(Xi- )(Xj-

)(Xj- )}=

)}= ...

... (xi-

(xi- )(xj-

)(xj- ) p(x1,x2,...xn) dx1dx2...dxn (8.4.14)

) p(x1,x2,...xn) dx1dx2...dxn (8.4.14)

|

Матрица si2 |

Корреляционные моменты является количественной мерой степени статистической связи (взаимной зависимости или корреляции) случайных величин Хi и Хj. Для системы случайных некоррелированных величин матрица корреляционных моментов является диагональной матрицей дисперсий с нулевыми значениями Kij при i ¹ j (см. пример матрицы si2).

Из выражений (8.4.13) и (8.4.14) следует достаточно простая связь между ковариационными и корреляционными моментами:

Kij = Rij -  ×

× .

.

В качестве безразмерной нормированной характеристики степени корреляции случайных величин используют также понятие коэффициентов корреляции, которые также образуют симметричную относительно главной диагонали матрицу со значениями, равными 1, по главной диагонали:

rij = Kij /(sisj) = ( -

-

)/sisj. (8.4.15)

)/sisj. (8.4.15)

|

Рис. 8.4.5. |

Значения коэффициентов корреляции заключены в пределах от -1 до +1. При r = 0 случайные величины считаются независимыми друг от друга (например, величины (Х,Y) на рис. 8.4.1), при |r| = 1 - полностью коррелированными (например, величины Х = b×Y с произвольным значением коэффициента b), во всех остальных случаях чем ближе значение |r| к 1, тем больше корреляция между случайными величинами, которая может иметь как прямой, так и обратный характер (при r<0). Величины Х и Y на рис. 8.4.5 явно коррелированны между собой с определенным коэффициентом прямой корреляции.

Попутно заметим, что если коэффициенты корреляции статистически независимых случайных величин всегда равны нулю, то обратное утверждение о статистической независимости случайных величин, если равен нулю их коэффициент корреляции, справедливо только для гауссовских распределений, а в общем случае является недостаточным. Полную гарантию статистической независимости дает только выполнение условия (8.4.9).

С учетом выражения (8.4.9) смешанные моменты статистически независимых случайных величин разделяются на произведения интегральных сомножителей. В частности, для ковариационных моментов случайных двумерных величин имеем:

M{X1X2} =  x1 p1(x1) dx1

x1 p1(x1) dx1  x2 p2(x2) dx2 = M{X1}M{X2}, (8.4.16)

x2 p2(x2) dx2 = M{X1}M{X2}, (8.4.16)

т.е. математическое ожидание произведения двух статистически независимых случайных величин равно произведению их математических ожиданий. Если математическое ожидание хотя бы одной из случайных величин будет равно нулю, то нулю становится равным и их произведение.

Пример. Плотность вероятностей задана выражением: p(x,y) = x+y, 0 £ x £ 1, 0 £ y £ 1.

Одномерные плотности вероятностей: p(x)= (x+y) dy =x+1/2, p(y)=

(x+y) dy =x+1/2, p(y)= (x+y) dx = y+1/2.

(x+y) dx = y+1/2.

Математические ожидания и дисперсии:

=

= x(x+1/2) dx = 7/12, Dx =

x(x+1/2) dx = 7/12, Dx = (x-7/12)2 (x+1/2) dx = 11/144.

(x-7/12)2 (x+1/2) dx = 11/144.

=

= y(y+1/2) dy = 7/12, Dy =

y(y+1/2) dy = 7/12, Dy =  (y-7/12)2 (y+1/2) dy = 11/144.

(y-7/12)2 (y+1/2) dy = 11/144.

=

=

xy(x+y) dx dy = 1/3.

xy(x+y) dx dy = 1/3.

Коэффициент корреляции: rxy = ( -

-

)/sxsy = (1/3 - (7/12)2)/(11/144) = -1/11.

)/sxsy = (1/3 - (7/12)2)/(11/144) = -1/11.

Замечание по терминологии. В современной технической литературе существует достаточно большая путаница по применению терминов ковариации и корреляции. Очень часто термин корреляции применяют как к центрированным, так и нецентрированным системам случайных величин и случайных процессов. В какой-то мере это можно считать допустимым, так как и то, и другое понятие применяется для характеристики корреляционной связи (взаимной зависимости) случайных величин. С другой стороны, матрицу смешанных центральных моментов второго порядка так же часто называют матрицей ковариации, и т.п.

Во избежание дальнейшей путаницы в понятиях примем за основу следующее. Однозначно понимаемым и повсеместно принятым термином теории вероятностей и математической статистики является коэффициент корреляции, который вычисляется по формуле (8.4.15) с использованием центральных моментов. А потому представляется логичным именно матрицу смешанных центральных моментов и смешанные моменты второго порядка центрированных случайных величин называть корреляционными, а смешанные начальные моменты нецентрированных случайных величин - ковариационными. Такой подход применен, например, в работе /л4/ и показал себя весьма эффективным в строгой логике математических построений.

Сумма и разность случайных величин анализируются достаточно просто с предварительным вычислением одномерных плотностей вероятностей соответствующих величин по формуле (8.4.4) или с использованием непосредственно плотностей вероятностей суммируемых случайных величин, если известны только последние и неизвестна многомерная плотность вероятностей, что чаще всего и имеет место на практике.

Средние значения сумм (разностей) случайных величин вычисляются по формулам:

, (8.4.17)

, (8.4.17)

так как математические ожидания сумм и разностей случайных величин равны соответствующим суммам и разностям их математических ожиданий. Средние значения случайных величин вычисляются по одномерным плотностям вероятностей.

Дисперсия суммы (разности) случайных величин может быть получена с использованием выражений, следующих из (8.3.9') и (8.4.15):

= sx2 +

= sx2 +  ,

,  =

=

+ rxy sx sy

+ rxy sx sy

Применяя эти выражения при вычислении среднего значения квадрата суммы (разности) двух случайных величин, получаем:

=

=  ± 2

± 2 +

+ = sx2 +

= sx2 +  ± 2

± 2

± 2 rxy sx sy + sy2 +

± 2 rxy sx sy + sy2 + =

=

sx2 + sy2 ± 2 rxy sx sy + ( ±

±  )2.

)2.

Отсюда, перенося последний член выражения в левую часть:

- (

- ( ±

±  )2 º (sx±y)2 = sx2 + sy2 ± 2 rxy sx sy. (8.4.18)

)2 º (sx±y)2 = sx2 + sy2 ± 2 rxy sx sy. (8.4.18)

Если случайные величины не коррелированны, то дисперсия их суммы или разности равна сумме их дисперсий.

Плотность вероятностей суммы (разности) случайных величин по известным плотностям вероятностей суммируемых величин в общем случае определяется достаточно сложно. Задача значительно облегчается, если случайные величины статистически независимы. Рассмотрим этот случай на примере случайной двумерной величины Z=X+Y с известными плотностями вероятностей px(x) и py(y).

Совместная плотность вероятностей p(z) = p(x,y) определяет функцию распределения вероятностей P(z) = P(Z £ z) = P(X+Y £ z), причем для каждой совместной реализации имеем z=x+y и, соответственно, x=z-y и y=z-x. Отсюда, с учетом статистической независимости случайных величин X и Y, и, соответственно, p(x,y) = px(x)×py(y), для распределения вероятностей P(z) имеем:

P(z) =

p(x,y) dx dy =

p(x,y) dx dy =  py(y)

py(y)  px(x) dx dy. (8.4.19)

px(x) dx dy. (8.4.19)

Продифференцируем данное выражение по z и, поскольку переменная z присутствует только в верхнем пределе второго интеграла, получим:

d P(z)/dz º p(x,y) = py(y) px(z-y) dy º py(y) * px(z-y). (8.4.20)

py(y) px(z-y) dy º py(y) * px(z-y). (8.4.20)

Аналогично, если принять y=z-x в качестве верхнего предела во втором интеграле выражения (8.3.19), можно получить:

p(x,y) = px(x) py(z-x) dx º px(x) * py(z-x). (8.4.20')

px(x) py(z-x) dx º px(x) * py(z-x). (8.4.20')

Таким образом, двумерная плотность вероятностей суммы случайных величин равна свертке их одномерных плотностей распределения вероятностей.

Для разности случайных величин Z=X-Y в выражении (8.3.19) верхний предел заменяется соответственно на z+y, при этом:

p(x,y) = py(y) px(z+y) dy º

py(y) px(z+y) dy º py(x-z) px(x) dx. (8.4.21)

py(x-z) px(x) dx. (8.4.21)

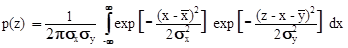

Сумма и разность нормальных распределений. Плотность вероятностей суммы Z=X+Y двух нормальных распределений случайных величин X и Y получается непосредственной подстановкой выражений гауссовских распределений (8.3.15) в (8.4.20):

. (8.4.22)

. (8.4.22)

Бесплатная лекция: "7 Основной вопрос философии, его структура" также доступна.

Аналогично для разности двух случайных величин Z=X-Y:

. (8.4.23)

. (8.4.23)

|

Рис. 8.4.6. |

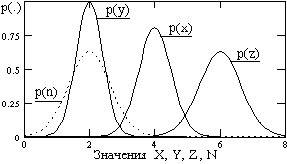

Как видно из полученных выражений, сумма и разность двух независимых нормально распределенных случайных величин также распределена нормально с дисперсией, равной сумме дисперсий исходных случайных величин, и со средними значениями, соответственно равными сумме и разности средних значений исходных величин. На рис. 8.4.6 в качестве примера приведены графики нормальных распределений случайных величин X ( =4, sx=0.5), Y (

=4, sx=0.5), Y ( =2, sy=0.4) и Z=X+Y, N=X-Y.

=2, sy=0.4) и Z=X+Y, N=X-Y.

Эти выводы действительны для сумм и разностей произвольного количества нормально распределенных случайных величин в любых сочетаниях и результатом всегда будет случайная величина с нормальной плотностью распределения вероятностей. Это свойство называется устойчивостью закона распределения случайной величины, и оно является достаточно редким. Для гауссовских распределений это свойство сохраняется даже для коррелированных случайных величин, естественно с определением дисперсии по выражению (8.4.18). А так как функция распределения Гаусса относится к числу собственных, то функции дифференцирования, интегрирования и других линейных преобразований гауссовского распределения также являются нормальными.