Энтропия

14. Энтропия. Её физический смысл с позиций термодинамики и молекулярной физики. Связь энтропии и информации.

Энтропия – это функция состояния системы, приращение которой равно теплоте, подведённой к системе в обратимом изотермическом процессе, делённой на абсолютную температуру при которой происходит этот процесс.

"Лекция 3" - тут тоже много полезного для Вас.

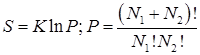

Больцман ввёл понятие энтропии, как величины, пропорциональной логарифму вероятности нахождения системы в конкретном макросостоянии.

P – это то число микросостояний, которыми может быть реализовано данное макросостояние.

K – Постоянная Больцмана 1,38х10-23 Дж/К.

Необратимые процессы, ведущие систему к увеличению энтропии, ведут систему к максимальному числу микросостояний, к ТД хаосу, равновесию.

В состоянии ТД равновесия, при максимальной энтропии, информационная структура системы нулевая. Энтропия и информация связаны, как обратные величины: уменьшение энтропии системы связано с увеличением информации этой системы.