Понятие количества информации

Понятие количества информации

Одну и ту же информацию можно передать на разных языках, при этом количество знаков в сообщении будет разным. Чтобы решить задачу наиболее экономного кодирования источника, необходимо определить понятия источника и количества информации.

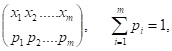

Источник сообщения определяют как объект, принимающий определенное состояние из некоторого множества, и характеризуют матрицей

где x1, x2,…,xm - набор знаков, характеризующих состояние объекта (алфавит объема m), pi - вероятности состояний. Сообщение несет информацию о текущем состоянии объекта. Вид распределения вероятностей характеризует уровень неопределенности (непредсказуемости) состояний. Если все состояния равновероятны, сообщение, указывающее конкретное состояние объекта, наиболее информативно, а неопределенность объекта максимальна. Количественная мера неопределенности должна удовлетворять естественным требованиям:

- возрастать с увеличением объема алфавита m,

- иметь максимум при равновероятных состояниях,

- суммироваться для независимых объектов.

Рекомендуемые материалы

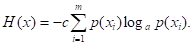

Математически доказано, что этим требованиям удовлетворяет только величина

В лекции "Социально-медицинская работа в сфере охраны материнства и детства" также много полезной информации.

Эта величина характеризует среднюю неопределенность одного знака алфавита источника и называется энтропией дискретного источника информации, как и аналогичная величина, введенная в термодинамике для описания степени разнообразия состояний физической системы. Знак «минус» введен для положительности энтропии, принято с =1, а = 2, единицей информации считается «бит» - энтропия объекта с двумя равновероятными состояниями:

H(x) = - (0.5 log2 0.5+0.5 log2 0.5) = 1(бит).

Если переданные знаки не искажены и неопределенность снята полностью, то количество переданной информации на один знак равно энтропии источника.

Энтропия источника, имеющего n равновероятных состояний, равна log2n. Если 32 буквы русского алфавита считать равновероятными, энтропия языка Н=5. Если учесть частоту появления букв в тексте, Н » 4,42, если учесть корреляцию соседних букв, Н » 3,53, а если и дальние связи букв, в том числе между словами, Н » 1,5. На рисунке показана вероятность появления букв русского алфавита.

Энтропия источника указывает минимальное теоретически возможное число двоичных символов, необходимое в среднем для кодирования одного знака алфавита источника.

Энтропия источника указывает минимальное теоретически возможное число двоичных символов, необходимое в среднем для кодирования одного знака алфавита источника.